12 月 17 日消息,刚刚,小米正式发布并开源新模型 MiMo-V2-Flash,先看表现:

MiMo-V2-Flash 总参数 3090 亿,活跃参数 150 亿,采用专家混合架构 (MoE),性能还能和 DeepSeek-V3.2、Kimi-K2 这些头部开源模型掰掰手腕。

除去「开源」这一标签,MiMo-V2-Flash 真正的杀手锏在于架构设计上的激进创新,把推理速度拉到了 150 tokens/秒,成本压到了每百万 token 输入 0.1 美元、输出 0.3 美元,主打一个超绝性价比。

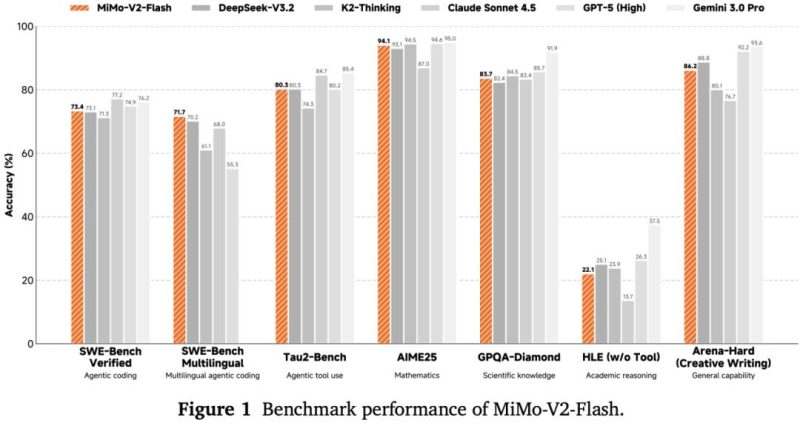

基准测试成绩显示,AIME 2025 数学竞赛和 GPQA-Diamond 科学知识测试中,MiMo-V2-Flash 都排在开源模型前两名。编程能力更是亮眼,SWE-bench Verified 得分 73.4%,超越所有开源模型,直逼 GPT-5-High。

转看智能体任务,MiMo-V2-Flash 在τ²-Bench 分类得分中,通信类 95.3 分,零售类 79.5 分,航空类 66.0 分,BrowseComp 搜索代理得分 45.4,启用上下文管理后直接飙到 58.3。

这些数据说明,MiMo-V2-Flash 不仅会写代码,还能真正理解复杂任务逻辑,执行多轮智能体交互。

值得一提的是,小米本次采用了混合滑动窗口注意力机制——采用了 5 比 1 的激进比例,5 层滑动窗口注意力搭配 1 层全局注意力交替使用,滑动窗口只看 128 个 token。

对此,罗福莉在社交平台上特别指出一个反直觉的发现:窗口大小 128 是「最佳甜点值」。其还表示,MiMo-V2-Flash 只是小米 AGI 路线图上的第二步。

此外 ,根据官方体验页面信息,MiMo-V2-Flash 还支持深度思考和联网搜索功能,既能对话聊天,也能在需要实时数据、最新动态或资料核对的场景里派上用场。

此外,MiMo-V2-Flash 采用 MIT 开源协议,基础版权重也已经在 Hugging Face 上发布。

Xiaomi MiMo AI Studio 体验地址:http://aistudio.xiaomimimo.com

HuggingFace 模型地址:http://hf.co/XiaomiMiMo/MiMo-V2-Flash

技术报道地址:http://github.com/XiaomiMiMo/MiMo-V2-Flash/blob/main/paper.pdf

文章来源于互联网:小米突然发布新模型:媲美 DeepSeek-V3.2

暂无评论内容